Desde el 1 de agosto de 2024 entró en vigor en la Unión Europea el AI Act (el Reglamento (UE) 2024/1689), que establece un marco común para el desarrollo, comercialización, puesta en servicio y uso de sistemas de inteligencia artificial.

El gobierno de España, además de aplicar este reglamento, ha impulsado el Anteproyecto de Ley para el buen uso y la gobernanza de la Inteligencia Artificial que establece un esquema de supervisión, reparto de competencias y régimen sancionador pero en el contexto nacional.

En este artículo te explicamos qué es la ley de inteligencia artificial en España, cómo se apoya en la legislación de inteligencia artificial en Europa, a quién afecta, cómo clasifica el riesgo, qué requerimientos tecnológicos y organizativos conviene implantar y qué hitos del calendario deben vigilar ya las empresas.

- Qué es la ley de inteligencia artificial en España

- A quién afecta la ley de IA en España

- Cómo clasifica la norma los sistemas de inteligencia artificial

- Requerimientos tecnológicos en sistemas de alto riesgo y organizativos que deben cumplir los proveedores

- Calendario de aplicación de la ley de IA en España

- Impacto estratégico de la ley en empresas tecnológicas

- Preguntas frecuentes (FAQ)

Qué es la ley de inteligencia artificial en España

La ley de inteligencia artificial fue aprobada en el parlamento de la Unión Europea en 2024, y marca un hito como la primera de este ámbito en el mundo. España implementó el reglamento en su anteproyecto nacional con el objetivo de establecer normas y fomentar modelos de IA de confianza.

Cuando se habla de ley de inteligencia artificial en España, nos referimos a dos planos normativos:

- El primero y principal es el AI Act europeo, aprobado por el Parlamento Europeo y el Consejo de la Unión Europea, y que entró en vigor desde agosto de 2024.

- El segundo es el desarrollo español de gobernanza y supervisión, con el que el Gobierno de España articula autoridades competentes, mecanismos de control, con adaptación en un aspecto institucional al marco europeo.

El AI Act europeo: la norma base que aplica en España

El AI Act es la primera regulación integral de la inteligencia artificial a gran escala y adopta un enfoque basado en el riesgo: cuanto mayor sea el potencial de daño sobre seguridad, salud o derechos fundamentales, más estrictas son las obligaciones.

La Comisión Europea impulsó la propuesta, el Parlamento Europeo la adoptó finalmente en marzo de 2024 y el Consejo de la Unión Europea le dio la aprobación final en mayo de 2024. De esta manera, el resultado fue el Reglamento (UE) 2024/1689, publicado en el Diario Oficial de la Unión Europea, y que ha sido aplicado de forma gradual.

Consideraciones:

- Para fines jurídicos, esta es la norma base de la regulación de la inteligencia artificial en España.

- Para estados miembros de la UE, este reglamento incluye empresas que desarrollan, integran, despliegan, distribuyen o usan sistemas de IA, incluso aunque no fabriquen el modelo desde cero. Por ello, el AI Act reparte obligaciones entre varios operadores, incluidos providers y deployers.

Qué añade España al marco europeo

España añade gobernanza nacional, autoridades competentes y una adaptación de carácter institucional. A tener en cuenta:

- La AESIA (Agencia Española de Supervisión de Inteligencia Artificial) nace como organismo público y su estatuto está aprobado por real decreto.

- El Consejo de Ministros aprobó en marzo de 2025 el Anteproyecto de Ley para el buen uso y la gobernanza de la Inteligencia Artificial.

- La regulación en España, además, está ligada a la Carta de Derechos Digitales, al papel supervisor de la AESIA y al ecosistema de cumplimiento ya existente, especialmente al RGPD (Reglamento General de Protección de Datos).

A quién afecta la ley de IA en España

El AI Act afecta tanto a creadores, proveedores, importadores, distribuidores, responsables de producto como también a empresas que despliegan o usan sistemas de IA en procesos internos o frente a clientes. Especialmente cuando se entra en usos de alto riesgo u obligaciones que deben considerar aspectos de transparencia.

Eso incluye, por ejemplo, organizaciones que usan IA para filtrar currículums, puntuar riesgos, verificar identidad biométrica, apoyar decisiones en educación, sanidad, empleo, crédito, justicia o acceso a servicios esenciales.

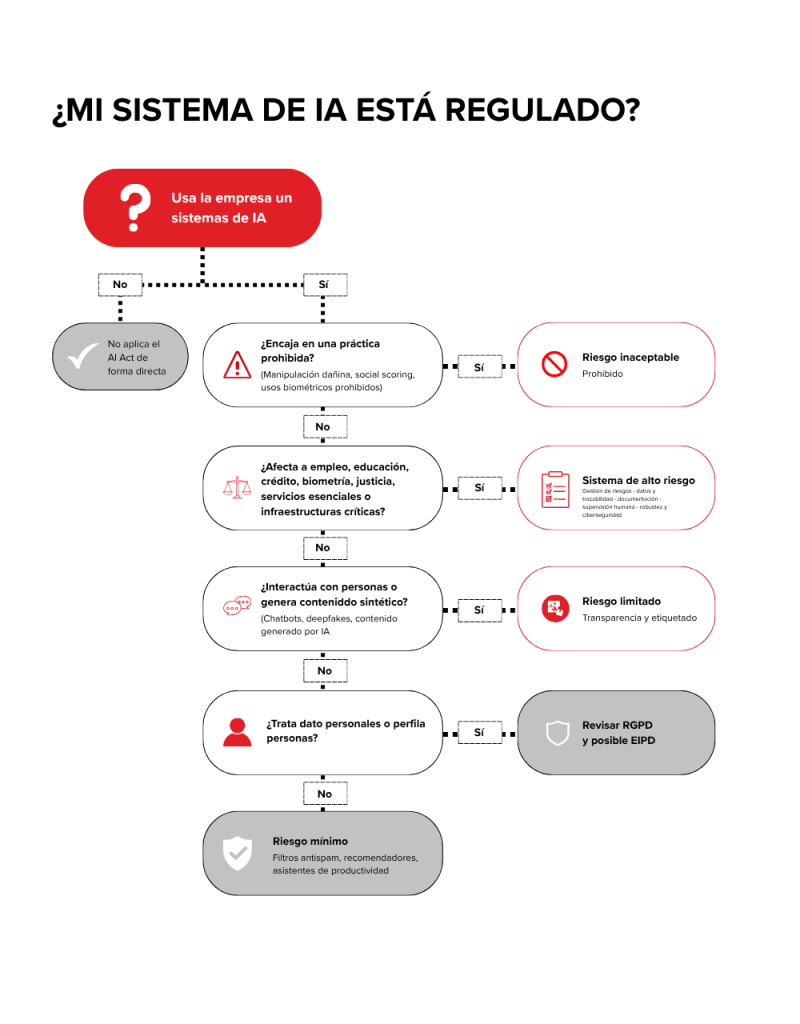

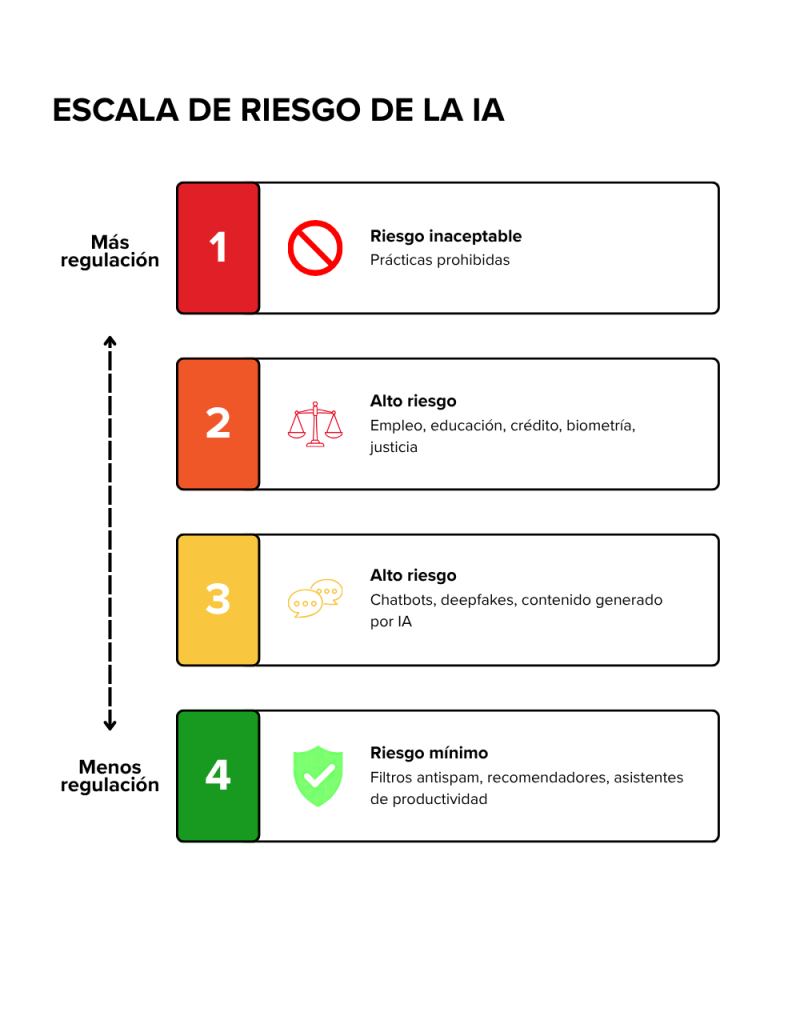

Cómo clasifica la norma los sistemas de inteligencia artificial

La AI Act contempla un enfoque escalonado de evaluación de la IA, que tiene en cuenta el nivel de riesgo y, a partir de ahí, define ciertas limitaciones:

- Riesgo inaceptable

- Alto riesgo

- Riesgo limitado

- Riesgo mínimo

Esta clasificación es la base técnica y jurídica del reglamento. De ahí se entiende por qué algunas prácticas se prohíben, otras deben pasar evaluaciones de conformidad y otras solo tienen que cumplir con obligaciones de transparencia.

Riesgo inaceptable

Las prácticas de riesgo inaceptable están prohibidas. La Comisión Europea publicó en febrero de 2025 directrices sobre prácticas prohibidas, con ejemplos ligados a manipulación dañina, explotación de vulnerabilidades, social scoring y ciertos usos de identificación biométrica remota en tiempo real por fuerzas de seguridad.

Sistemas de alto riesgo

Aquí entran determinados productos como:

- Aplicaciones en empleo (por ejemplo, herramientas para filtrar currículums o evaluar candidatos)

- Educación (como sistemas de corrección automatizada o de admisión

- Acceso a servicios privados esenciales (por ejemplo, scoring para conceder créditos o priorizar ayudas)

- Infraestructuras críticas (como sistemas de gestión en energía o transporte)

- Biometría (por ejemplo, reconocimiento facial o verificación de identidad) o administración de justicia (como herramientas de apoyo para analizar pruebas o valorar riesgos procesales)

Riesgo limitado y obligaciones de transparencia

Aquí se incluyen:

- Sistemas de inteligencia artificial que sin ser de alto riesgo, exigen ciertas obligaciones de transparencia. Ejemplos:

- Cuando una persona interactúa con un sistema de IA sin saberlo.

- Cuando se generan contenidos sintéticos como textos, imágenes, audios o vídeos que podrían inducir a error si no se identifican correctamente.

En estos casos, la norma no impone el mismo nivel de exigencia que para los sistemas de alto riesgo, pero sí obliga a informar de forma clara sobre el uso de inteligencia artificial.

El objetivo es que usuarios, clientes o ciudadanos sepan cuándo están ante contenido generado o manipulado por IA y puedan actuar con conocimiento.

Riesgo mínimo

La mayor parte de las aplicaciones comunes de IA.

Aun así, el hecho de que una solución no sea de “alto riesgo” no elimina otras obligaciones aplicables, como las derivadas del RGPD, la normativa sectorial o deberes contractuales y de seguridad de la información.

Requerimientos tecnológicos en sistemas de alto riesgo y organizativos que deben cumplir los proveedores

La AI Act distingue entre roles y niveles de riesgo, sin embargo, para lograr esto toda organización con cierta exposición a IA necesita una base mínima de gobernanza, trazabilidad, seguridad y supervisión con el fin de mantener el cumplimiento, especialmente en sistemas clasificados como de “alto riesgo”

El siguiente artículo puede interesarte: AI Gateway | Gestión Inteligente entre aplicaciones, modelos y APIs de IA

1. Gestión de riesgos durante todo el ciclo de vida

La regulación europea exige una gestión de riesgos continua, como lo detalla el artículo 9. Para esto, se deben identificar riesgos previsibles antes de la puesta en servicio, validarlos con pruebas, controlarlos durante la operación y revisarlos tras incidentes, cambios relevantes o ampliaciones de uso.

La recomendación es implantar un marco de gobierno que cubra al menos:

- Inventario de casos de uso

- Clasificación de riesgo

- Controles por caso

- Responsables

- Criterios de escalado

- Procedimientos de reevaluación cuando el modelo, los datos o el contexto cambien

2. Gobernanza, calidad y trazabilidad de los datos

Buena parte de los sesgos, errores y resultados discriminatorios nace de este punto. Los sistemas de alto riesgo deben trabajar con prácticas adecuadas de gobernanza de datos, documentación, pertinencia y control de calidad del conjunto de entrenamiento, validación y prueba, como se menciona en el artículo 10.

En países como España, además, cuando hay datos personales, la empresa debe alinear ese trabajo con el RGPD, el principio de protección de datos desde el diseño, y, cuando proceda, con una evaluación de impacto de protección de datos (EIPD).

La AEPD recuerda que existe obligación general de EIPD cuando el tratamiento implique alto riesgo para derechos y libertades.

3. Transparencia, explicabilidad y etiquetado de contenidos generados con IA

Esto no necesariamente significa abrir todo el código fuente, sin embargo, si sugiere ofrecer información útil y proporcional sobre el funcionamiento, los límites y la naturaleza artificial de ciertos contenidos o interacciones. Este requerimiento, se puede observar a detalle en el artículo 50 y en las obligaciones documentales para modelos de propósito general y sistemas de alto riesgo.

Para esto se pueden contemplar:

- Interfaces que avisen cuando el usuario interactúa con IA.

- Metadatos o marcas para contenidos sintéticos.

- Fichas de modelo.

- Documentación para integradores.

- Criterios internos sobre qué puede automatizarse y qué debe explicarse al cliente, empleado o tercero afectado.

4. Supervisión humana, robustez y ciberseguridad

La regulación exige supervisión humana. Para esto, es pertinente diseñar procesos donde una persona competente pueda entender cuándo intervenir, detectar anomalías y evitar que el sistema produzca o consolide daños automáticamente como se distingue en el artículo 14.

Junto a ello, el reglamento también requiere niveles que sean adecuados de exactitud, robustez y ciberseguridad necesaria. Así mismo se requieren sistemas resilientes a errores o intentos de manipulación.

Aquí conviene fijar controles como revisión humana en:

- Decisiones sensibles

- Pruebas de resistencia

- Limitaciones de uso

- Gestión de permisos

- Seguridad del pipeline de datos

- Hardening de integraciones

- Control de prompts y protección frente a manipulación, fuga de información o degradación del modelo

5. Documentación, registro y monitorización

Uno de los puntos más importantes es la documentación. Para esto es necesario contar con evidencias: documentación técnica, conservación de registros, información para desplegadores y, en ciertos casos, monitorización poscomercialización e informe de incidentes.

Sin trazabilidad, el cumplimiento es muy difícil de demostrar, todo esto mencionado en el artículo 53 de la ley.

Por esto, es importante implantar cuanto antes un sistema documental que recoja: finalidad del sistema, datasets usados, limitaciones conocidas, resultados de pruebas, métricas de error, incidencias, cambios de versión, responsables de aprobación y controles de uso.

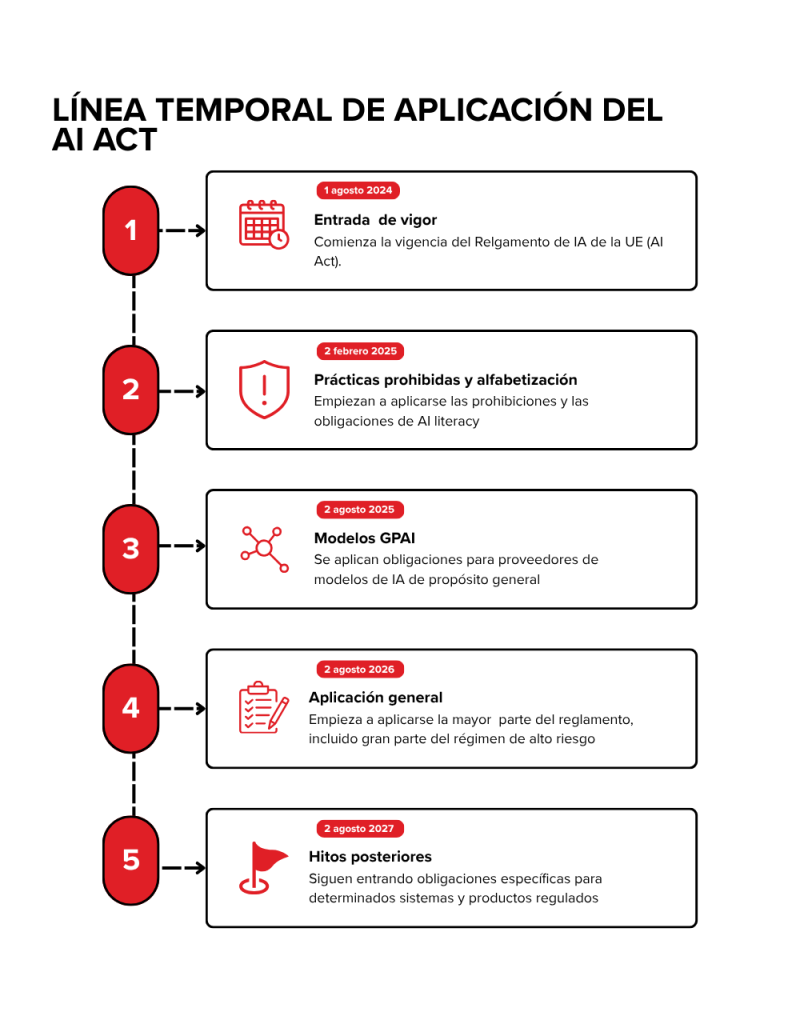

Calendario de aplicación de la ley de IA en España

El calendario no es lineal: el AI Act entró en vigor el 1 de agosto de 2024, pero su aplicación se despliega por fases. La Comisión Europea resume que será plenamente aplicable el 2 de agosto de 2026, con excepciones importantes antes y después de esa fecha.

Qué obligaciones ya están en marcha

- Desde el 2 de febrero de 2025: obligaciones sobre prácticas prohibidas y el deber de promover un nivel suficiente de AI literacy o alfabetización en IA por parte de proveedores y desplegadores.

- Desde el 2 de agosto de 2025: obligaciones para proveedores de modelos de IA de propósito general (GPAI). La Comisión Europea lo ha explicado en sus FAQs oficiales y en sus directrices para proveedores: aquí entran deberes de documentación técnica, información para actores downstream y requisitos adicionales para modelos con riesgo sistémico.

Qué hitos posteriores deben vigilar las empresas

Desde el 2 de agosto de 2026 se volverá aplicable el régimen, incluidos los requisitos y obligaciones del reglamento para sistemas de alto riesgo, además del marco de gobernanza y sanción a escala europea y nacional, se aplicarán los requisitos completos para los sistemas de IA de alto riesgo hasta 2027.

El siguiente artículo puede interesarte: QA Automation en tus APIs con inteligencia artificial

Impacto estratégico de la ley en empresas tecnológicas

La regulación de inteligencia artificial en España y en la UE a medio plazo, las empresas que documenten mejor sus modelos, controlen su cadena de datos y demuestren gobernanza, evaluación de conformidad y supervisión humana tendrán una ventaja competitiva basada en la confianza y el cumplimiento normativo.

Cómo adaptarse a la Ley de Inteligencia en España

Para una adaptación adecuada del la ley, se deben contemplar tres cosas:

- Primero, mapear todos los usos de IA: internos, comerciales, experimentales y de terceros.

- Segundo, clasificarlos por riesgo y marco normativo: AI Act, RGPD, normativa sectorial, DSA si procede.

- Tercero, cerrar brechas técnicas y organizativas con prioridades realistas.

De esta manera, un plan de adaptación maduro debería incluir al menos:

- Inventario de sistemas y proveedores

- Política de uso de IA

- Formación y AI literacy para equipos

- Revisión contractual con vendors

- Gobierno de datos

- Controles de trazabilidad

- Revisión humana en procesos sensibles

- Etiquetado de contenidos generados

- Evaluación de impacto cuando corresponda y un sistema de evidencias para auditoría o supervisión.

Preguntas frecuentes (FAQ)

¿Existe ya una ley de inteligencia artificial en España?

Sí, pero la norma principal es el AI Act europeo, que es un reglamento directamente aplicable en España. Además, España ha impulsado un Anteproyecto de Ley para el buen uso y la gobernanza de la Inteligencia Artificial para ordenar la supervisión nacional y el reparto de competencias.

¿El AI Act España solo afecta a empresas que desarrollan IA?

No. También puede afectar a empresas que despliegan o usan sistemas de IA, especialmente si entran en categorías de alto riesgo o si deben cumplir obligaciones de transparencia o alfabetización en IA.

¿Qué pasa si mi empresa usa ChatGPT u otro modelo generativo de terceros?

Depende del caso de uso y del rol de tu empresa. Aunque no desarrolles el modelo, puedes tener obligaciones como desplegador, especialmente si lo integras en procesos sensibles, generas contenidos para terceros o tratas datos personales. Además, desde el 2 de agosto de 2025 existen obligaciones específicas para proveedores de GPAI.

¿Qué sistemas se consideran de alto riesgo?

Entre otros, ciertos sistemas usados en empleo, educación, biometría, servicios esenciales, infraestructuras críticas, migración, justicia o aplicación de la ley, además de algunos productos regulados con componentes de IA.

¿Qué obligación ya debería estar revisando una empresa hoy?

Como mínimo, dos: verificar que no incurre en prácticas prohibidas y asegurar un nivel suficiente de AI literacy para las personas que usan u operan IA en su nombre.

¿Cómo se relaciona el AI Act con el RGPD?

No se sustituyen. Si tu sistema de IA trata datos personales, el RGPD sigue plenamente vigente. En muchos casos habrá que analizar base jurídica, minimización, decisiones automatizadas, perfilado y, si existe alto riesgo para derechos y libertades, realizar una EIPD.

La Ley de Inteligencia Artificial está estableciendo un marco regulatorio que permite a las empresas actuar bajo criterios éticos, garantizando la transparencia en la forma en que adoptan, despliegan y supervisan la IA. Al mismo tiempo, pone el foco en la protección de los derechos fundamentales y de los datos sensibles, especialmente en aquellos casos en los que el uso de la inteligencia artificial puede generar un mayor impacto sobre las personas.

¿Estás evaluando tus sistemas y necesitas definir una arquitectura sólida y segura?

Contacta con nuestro equipo y te ayudaremos a impulsar tu estrategia digital con una base tecnológica preparada para el futuro.

Fuentes oficiales

- Reglamento (UE) 2024/1689 — AI Act en EUR-Lex

- AI Act — Comisión Europea / Shaping Europe’s digital future

- FAQ oficial para navegar el AI Act

- Consejo de la UE: aprobación final del AI Act

- Parlamento Europeo: texto adoptado del AI Act

- BOE: Reglamento (UE) 2024/1689 en español

- La Moncloa: Anteproyecto de Ley para el buen uso y la gobernanza de la IA

- AESIA — sitio oficial

- BOE: Estatuto de la AESIA

- AEPD — Innovación y Tecnología

- AEPD — tratamientos que incluyen IA

- AI literacy — preguntas y respuestas oficiales

- Modelos GPAI — preguntas y respuestas oficiales